/사진제공=Google DeepMind

2025.02.14 17:07

- 0

마치 허공에서 뚝 떨어진 것 같은 기술이었지만 생성AI는 지난 2년간 놀라운 성장을 이뤘다. 이 혁명의 대표주자인 챗GPT가 널리 사용 가능해진 게 2022년 11월 30일이었다는 것이 믿기지 않을 정도다. 거품이 곧 터지리라는 이야기에도 불구하고 과장과 열광은 끊임없었고 앞으로도 계속될 것이다. 하지만 호들갑을 떠는 사람들의 말에도 일리가 있다. 생성AI는 수많은 산업을 뒤흔들고 있으며, 많은 사람들은 이것이 충격적으로 강력하면서도 놀랍도록 유용하다고 생각한다. 의료 분야에서 AI 시스템은 이제 의사들이 환자 기록을 요약하고 치료법을 제안하는 데 도움을 주고 있다. 다만 여전히 오류 가능성이 있어 세심한 감독이 필요하다. 창작 분야에서 AI는 개인화된 마케팅 콘텐츠부터 완전한 비디오 게임 환경까지 모든 것을 만들어내고 있다. 한편 교육 분야에서는 AI 기반 도구들이 난해한 학술 텍스트를 단순화하고 개별 학생의 필요에 맞춰 학습 자료를 맞춤식으로 제공하고 있다.

내 삶에서도 새로운 AI는 일상적인 일과 전문적인 업무에 접근하는 방식을 새롭게 형성했지만, 그 중에서도 언어 학습에서만큼 극적인 변화는 없었다. 코딩에 대해 쥐뿔도 모르는 나는 최근 세 가지 다른 AI 기반 서비스를 활용하여 원어민 오디오가 포함된 맞춤형 단편 이야기를 제작하는 앱을 만들었다. 이 이야기들은 내 학습의 부족한 부분에 맞춰진 까다로운 어휘와 관용구로 가득 차 있다. 내가 'Vergesslichkeit(독일어로 "건망증")'와 같은 단어에 골머리를 앓을 때, 그 단어는 내가 숙달하려고 노력하는 다른 수십 개의 단어들과 함께 계속해서 나타난다.

20년이 넘는 언어 학습 기간 동안 이렇게 강력한 도구를 사용해본 적이 없다. 이는 생산성을 높일 뿐만 아니라 효율성 자체를 재정의하는데 이것이 바로 생성AI의 핵심 약속이다. 그 규모와 속도는 정말 인상적이다. 단 15분 만에 6개 언어로 된 60개의 맞춤형 이야기와 수 시간 분량의 오디오를 받아볼 수 있는 다른 방법이 어디 있겠는가? 이 모든 것이 웹을 가볍게 둘러보는 동안 가능하다. 게다가 더 놀라운 점은? 내 노트북에 조용히 자리 잡고 있는 이 앱 전체를 만드는 데 반나절도 채 걸리지 않았다는 것이다. 챗GPT가 코딩해 주었기 때문이다. Vergesslichkeit, au revoir! (건망증이여 안녕!)

하지만 생성AI는 기술적 경험의 새로운 황홀경만 가져온 것이 아니다. 새로운 고통도 가져왔다. 교육에서의 활용이 좋은 예다. 챗GPT는 맞춤형 학습을 가능케 하지만 한편으로는 광범위한 부정행위도 가능케 한다. 생성AI가 이미 그랬듯이 악행을 저지르는 데 드는 비용이 줄어드는 것은 도덕적 공황으로 이어진다. 따라서 생성AI 기술이 가져올 것으로 예상되는—몇몇 경우에선 이미 체감되고 있는—영향에 대한 공공의 우려가 커지고 있다. 정부와 기업 기관의 자동화된 의사결정부터 감시, 형사 사법, 심지어 전쟁에서의 역할까지, AI의 영향력은 사회적, 정치적 생활에 깊이 침투해 있다. AI는 편향을 영구화하고, 부의 불평등을 악화시키며, 중대한 과정에서 책임소재를 모호하게 할 잠재력이 있어 그 영향력에 대한 시급한 질문들을 제기하고 있다.

[새로운 PADO 기사가 올라올 때마다 카톡으로 알려드립니다 (무료)]

이러한 우려의 대부분은 더 큰 구조적 문제를 지적한다. AI 기술에 대한 권력이 소수의 기업에 집중되어 있다는 것이다. 빅테크가 클라우드 컴퓨팅, 문서 작성, 심지어 검색을 관리하게 하는 것은 그나마 낫다. 이런 영역에서는 악용의 가능성이 작아 보인다. 하지만 생성AI 기술의 권력이 소수의 빅테크에게 집중될 경우 그 여파는 훨씬 커질 수 있다. 때문에 기술과 민주주의 사이의 전반적인 관계에 대한 논쟁에 다시 불이 붙고 있다.

AI에 더 많은 민주주의가 필요하다는 광범위한 합의가 있지만, 구체적으로 AI의 민주화가 무엇을 수반하는지는 여전히 치열한 논쟁거리다. 일각에서는 AI 시스템을 구동하는 모델과 데이터셋의 투명성 확대를 AI의 민주화로 본다. 다른 이들은 오픈AI와 앤트로픽Anthropic 같은 거대 AI 기업에 도전할 수 있는 오픈소스 대안을 주장한다. 일부는 접근 장벽을 낮추거나 사유화된 AI 서비스에 대한 대안을 공공 부문에 구축할 것을 요구한다. 하지만 이러한 해결책 대부분은 AI 구현 단계에서의 민주적 결핍을 해결하는 협소한 부분에 초점을 맞추고 있으며, 이미 배포되었거나 개발 중인 AI 시스템에 대한 실용적인 조정을 우선시한다. 이러한 관점을 옹호하는 사람들—현실주의자라고 하자—은 AI가 이미 정착했고, 그 가치는 우리가 어떻게 사용하느냐에 달려 있으며, 적어도 진지한 정치적 감독이 필요하다고 주장한다.

한편, 소수이지만 점차 그 수가 늘고 있는 학자 및 활동가 그룹은 AI의 기반에 얽혀 있는 더 깊은 체계적 문제들, 특히 냉전 시대 컴퓨터 기술에서 오늘날의 AI가 비롯되었다는 점을 겨냥하고 있다. 이러한 거부론자refusenik들에게 AI는 단순히 결함 있는 기술 이상이다. 그것은 식민주의적이고, 배타적이며, 인종차별적이고, 심지어 우생학적인 프로젝트로서, 그 근원부터 이미 돌이킬 수 없을 정도로 오염되어 있다. 이를 민주화하는 것은 영국 상류층 사교클럽을 프롤레타리아 도서관으로 변모시키길 희망하는 것과 같다. 표면적인 개혁으로는 충분하지 않을 것이다.

AI 연구자들은 그들 나름대로 상당한 독립성을 가지고 운영했다고 주장한다. 한 연구자가 1997년 많은 논의를 불러일으킨 에세이에서 말했듯이, "만약 그 수십 년 동안 AI 분야가 군대의 하인이었다면 AI는 매우 관대한 주인의 덕을 봤다고 할 수 있다." 만약 AI 연구 커뮤니티가 정말로 그러한 자율성을 누렸다면 왜 전복적이거나 급진적인 혁신이 거의 나오지 않았을까? 보수주의와 군산복합체와의 얽힘이 처음부터 연구 의제에 뿌리박혀 있었던 것일까? 반체제적 AI가 존재하는 건 가능할까? 만약 그렇다면 어떤 모습일까? 더 중요한 것은 이런 논의가 오늘날 중요하느냐다. 그렇지 않으면 우리는 현실주의적 입장을 수용해, AI를 있는 그대로 받아들이고 AI 개발의 민주화에 집중해야 하는가?

AI 비판 이론은 시간이 지나면서 진화해왔다. 예를 들어 한때는 거부론자 중에 AI가 결코 성공하지 못할 모든 이유를 분석하는 데 큰 즐거움을 느낀 'AI 무용론자'들이 꽤 많았다. 근래의 생성AI가 작동하는 원리는 당시 철학적 성향의 회의론자들이 비판했던 AI 작동 원리와는 거리가 멀어 무용론자들의 입장은 위기에 처한 것으로 보인다. 오늘날 남아있는 무용론자들은 킬러 로봇의 망령과 아직 오지 않은 인공일반지능(AGI)—오랫동안 테크 산업의 미래주의적 꿈의 시금석이었다—에 초점을 맞추고 있다.

물론 다른 입장들도 있다. AI 논쟁에 대한 나의 개괄이 모든 뉘앙스를 포착하는 것은 아니다. 하지만 우리는 현실주의자들과 거부론자들이라는 양대 진영 모두가 결국 인공지능을 고정된 것으로 간주한다는 사실을 직시해야 한다. 현실주의자는 그것을 거의 유일하게 실현 가능한 형태의 AI로 받아들이기 위해, 거부론자는 그것을 군산복합체나 테크 업계의 자기중심적 환상이 낳은 구제불능의 산물로 비난하기 위해서 그렇게 한다. AI에 결여된 '타자'가 무엇일지에 대해 생각하려는 노력은—그것이 연구 의제의 형태든, 정치적 프로그램이든, 기술의 집합이든, 혹은 더 나아가 이 모든 것의 조합이든—상대적으로 거의 없다.

[종교를 통해 본 한국 — PADO '광화문클럽' 새해 첫 클럽데이가 1월 21일(수) 열립니다!]

이러한 간극을 메우기 위해, 나는 AI와 민주주의에 대해 생각하는 다른 방식을 제시하고자 한다. 현실주의자나 거부론자 한 쪽의 편을 드는 대신, 나는 급진적으로 유토피아적인 질문을 제기한다. 만약 우리가 시계를 되돌려 컴퓨터 과학자들을 냉전의 악영향으로부터 보호할 수 있었다면, 어떤 종류의 더 민주적이고, 공공정신을 갖춘, 덜 군국주의적인 기술 의제가 출현할 수 있었을까? 그 대안적 비전은—우리가 그것을 "인공지능"이라고 부르든 다른 무엇이라고 부르든—오늘날의 AI 발전이 가진 가능성과 위험을 측정할 수 있는 의미 있는 지평을 제공한다.

우리가 어떤 길을 걸을 수 있었을지 보기 위해서는 AI의 탄생 현장으로 돌아가야 한다. AI 연구가 처음으로 시작된 1950년대 중반—펜실베이니아대학교에서 최초의 디지털 컴퓨터인 에니악ENIAC이 만들어진 지 불과 10년 후—부터 AI 연구 커뮤니티는 자신들이 만들고자 하는 기계 지능이 목적론적임을 숨기지 않았다. 특정한 목표, 즉 텔로스telos를 달성하는 것을 지향했다.

랜드연구소 지원으로 1957년에 개발된 GPS(General Problem Solver)라는 소프트웨어 프로그램을 보자. 개발자들—허버트 A 사이먼, 앨런 뉴웰, JC 쇼—는 소위 "보편적" 문제 해결사를 만들기 위해 "수단-목적 분석"이라는 기법을 사용했다. 실제로 이 소프트웨어가 다룰 수 있는 문제들은 고도의 형식을 따라야 했다. 목표가 명확하게 정의되어 있고, 문제해결 환경이 안정적(즉, 과정을 지배하는 규칙이 처음부터 고정되어 있음을 의미)이며, 원하는 목적을 달성하기 위해 다양한 수단을 시도할 수 있는 여러 차례의 반복이 허용될 때 가장 잘 작동했다.

물론 AI 연구에서 이러한 "규칙 기반" 패러다임은 결국 신경망에 기반한 경쟁 접근방식에 밀려났다. 신경망 기반 접근법은 챗GPT와 같은 시스템을 구동하는 거대 언어 모델(LLM)을 포함한 모든 현대 머신러닝의 기초가 되었다. 하지만 그때에도 초기 신경망 접근방식은 문제 해결이라는 관점에서 구성되었다. 패턴 인식을 위해 설계된 초기 신경망인 퍼셉트론Perceptron의 예상 응용 분야 중 하나는 군사적인 것으로, 위성 이미지를 판독해 적군의 표적을 탐지하는 것이었다. 신경망은 명확하게 정의된 목표와 그 과제를 달성하기 위해 훈련된 모델을 필요로 했다. 특정한 목표나 그것을 달성하기 위한 이전 시도가 명확하게 기록되어 있지 않으면 작동하지 않을 것이었다.

초기 AI 도구들이 AI 연구를 주도한 바로 그 기관들—정부, 기업, 군대—에서 사무직과 행정직 근로자들의 도구적 이성을 밀접하게 반영한 것은 우연이 아니라고 생각한다. 이들은 시간과 주의력이 제한되어 있었고, 실수가 상당한 비용을 초래하는 근로자들이었다. 기계를 통해 그들의 업무를 자동화하는 것은 논리적인 다음 단계이자 오류와 비용을 줄이는 효율적인 방법으로 보였다. AI 연구가 목표중심적으로 이루어진 이유 중 하나는 자금 조달의 필요성으로 볼 수 있다. 초기 AI는 실용적으로 어떤 가치가 있는지를 입증해야 했다. 하지만 더 깊은 이유는 AI가 사이버네틱스로부터 받은 지적 유산에 있다. 사이버네틱스란 AI 연구 초기에 많은 영향을 미쳤으나 AI가 독자적인 분야로 자리잡으려 하면서 옆으로 밀려난 학문이다.

사이버네틱스의 선구자들은 유도탄부터 온도조절기에 이르는 피드백 기반 기술들이 어떻게 의식적으로 의도하지 않아도 목표지향적 행동을 보일 수 있는지에 매료되었다. 그들은 이러한 시스템들과 인간 지능의 목적론적 측면—유리잔을 들어올리거나 문손잡이를 돌리는 것과 같은—사이의 유사점을 도출했는데, 이는 우리가 피드백 제어를 통해 목표를 달성할 수 있게 해준다. AI는 이러한 사이버네틱스 프레임워크를 차용하면서 이 은유를 더 발전시켰다. 온도조절기가 목표 온도를 "추구"할 수 있다면 디지털 컴퓨터가 왜 목표를 "추구"할 수 없겠는가?

하지만 중요한 차이점이 있었다. 초기 사이버네틱스 연구자들은 한 발은 기계공학에, 다른 발은 생물과학에 두고 있었다. 그들은 자신들의 유추를 뇌와 신경계가 실제로 어떻게 기능하는지 이해하는 방법으로 보았고, 필요한 경우 뇌와 신경계에 대한 자신들의 모델을 수정했다. 때로는 현실을 더 잘 반영(또는 그들의 용어로 "구현embody")하기 위해 새로운 기기를 설계하기도 했다. 다시 말해, 사이버네틱스 연구자들은 자신들의 모델이 단지 실제로 존재하는 지능의 모델일 뿐임을 인정했다. 반면에 AI 학문은 은유를 현실로 뒤바꿨다. AI의 선구자들은 주로 수학자와 논리학자로, 생물학이나 신경과학의 배경이 없었다. 대신 지능은 디지털 컴퓨터에서 복제될 수 있는 것으로 정의되었다. 이는 생물학에 영감을 받은 신경망의 경우에도 변함없이 목표를 추구하거나 문제를 해결하는 것을 의미했다.

아이러니하게도 초기 AI에 대한 가장 저명한 철학적 비평가들—특히 UC버클리 철학 교수이자 영향력 있는 저서 '컴퓨터가 할 수 없는 것'(1972)의 저자인 휴버트 드레이퍼스Hubert Dreyfus—은 이러한 목표지향적 문제 해결에 대한 집착을 비판하지 않았다. 마르틴 하이데거의 '존재와 시간'에서 나오는 망치로 못 박기에 대한 성찰을 바탕으로, 드레이퍼스는 인간의 전통과 문화에 내재된 암묵적 지식을 체계화하는 것이 얼마나 어려운지를 강조했다. 드레이퍼스는 가장 일상적인 작업조차도 문화적 맥락에 의해 깊이 형성된다고 주장했다. 우리는 명시적이고 보편적인 지침으로 형식화될 수 있는 고정된 규칙을 따르지 않는다는 것이다.

그의 주장은 우리가 기계에게 우리처럼 행동하도록 가르칠 수 없다는 것을 보여주려는 것이었지만 AI의 목적론적 정신—목표 지향적 문제 해결에 대한 집중—자체를 겨냥하지는 못했다. 하이데거 자신이 그러한 비판의 한 변형을 제시했다는 점을 고려하면 이는 더욱 의아한 일이다. 그는 우리에게 못을 더 효과적으로 박는 방법을 가르치려는 사명을 가진 생산성에 집착한 스타하노프주의자가 아니었고, 분명히 목표지향적 행동을 인간 생활의 본질적 특징으로 보지 않았다.

오히려 하이데거는 망치가 망가졌을 때뿐만 아니라 망치질에 지쳤을 때도 우리가 세계가 어떻게 작동하는지 주목하게 된다고 지적했다. 그는 이러한 지루함의 순간에 우리는 목표의 긴급성으로부터 벗어나, 더 광범위하고 유동적이며 맥락적인 형태의 지능을 암시하는 보다 열린 방식으로 세계를 경험한다고 주장했다. 단순히 과제를 효율적으로 달성하는 것이 아니라 우리 환경과의 더 깊은 상호작용을 포함하며, 형식화하기 어려운 방식으로 우리를 의미와 목적으로 인도하는 것이다. 하이데거의 세계는 외로워 보일 수 있으나—대부분 망치와 현존재Dasein 뿐이지만—우린 서로와 상호작용을 하면서 우리의 목표에 대해 하이데거식으로 성찰할 수 있다.

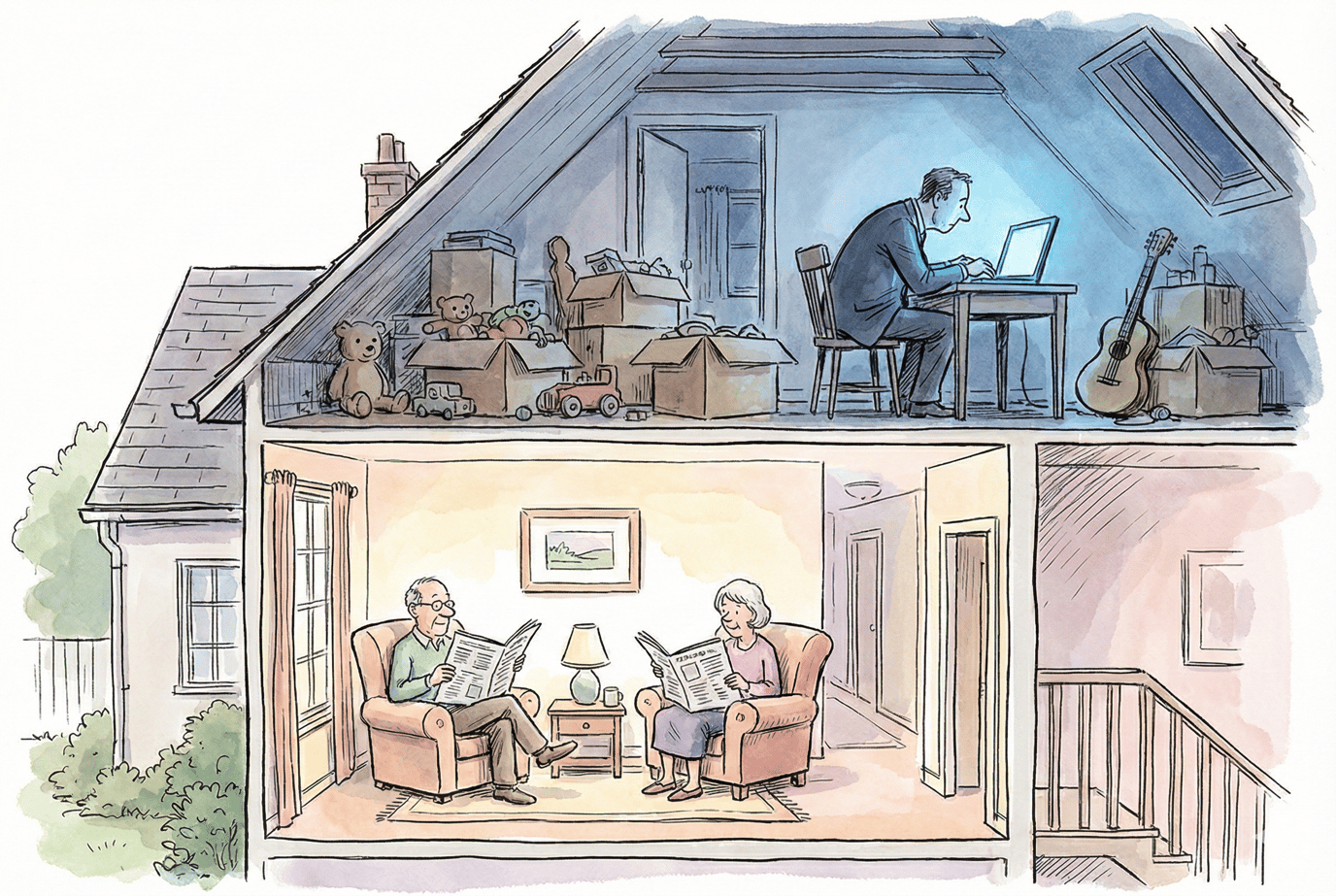

하지만 1950년대 AI 선구자들에게 이는 처음부터 고려 대상이 아니었다. 지루함과 상호주관성intersubjectivity과 같은 개념들은 명확한 목적론적 근거가 부족했기 때문에 지능과 무관해 보였다. 대신 초기 AI는 완전히 헌신적이고, 외부적으로 동기부여되며, 감정적으로 분리된 사무직 근로자—윌리엄 화이트의 '조직인organization man'이 보다 신뢰할 수 있는 디지털 복제본으로 대체될 준비가 된 버전—의 지능을 복제하는 데 집중했다.

드레이퍼스의 하이데거적 비판이 AI 커뮤니티 내에서 반향을 일으키는 데 거의 10년이 걸렸지만, 그것이 실현되었을 때는 중요한 재편성으로 이어졌다. 가장 주목할 만한 사례 중 하나는 스탠포드대의 컴퓨터 과학 교수 테리 위노그라드Terry Winograd의 작업에서 나타났는데 그는 자연어 처리 분야에서 존경받는 인물로 드레이퍼스도 그의 작업을 인정했다. 1980년대에 위노그라드는 획기적인 전환을 했다. 그는 인간 지능을 복제하는 대신 인간의 행동과 맥락을 이해하는 데 집중하기 시작했고, 인간의 지능을 모방하는 것이 아니라 증폭시키는 도구를 설계하는 걸 목표로 삼았다.

이러한 전환은 위노그라드가 칠레의 정치인 출신 철학자이자 연쇄 창업가인 페르난도 플로레스Fernando Flores와의 협력을 통해 개발한 소프트웨어 시스템 '코디네이터'의 개발로 구체화되었다. 그 이름이 시사하듯, 코디네이터는 직원들이 동료와의 전자적 상호작용을 분류—그것이 요청인지, 약속인지, 명령인지—할 수 있게 함으로써 어떻게 응답할지에 대한 모호성을 줄이고 직장 내 협응coordination을 개선하고 촉진하는 걸 목표로 했다. 적절하게 분류된 메시지들을 추적하고 그에 부합하여 업무를 처리할 수 있었다.

인간-컴퓨터 상호작용과 상호작용 설계의 원칙에 기반한 이 접근방식은 새로운 지적 의제를 설정했다. 기계에 인간의 지능을 복제하려고 노력하는 대신, 기계로 인간의 지능을 향상시켜 사람들이 더 효율적으로 목표를 달성할 수 있도록 도우면 어떨까? 전통적인 AI의 거창한 약속에 대한 믿음이 약해지기 시작하면서 위노그라드의 비전은 힘을 얻었고, 그의 수업을 들었던 래리 페이지, 리드 호프만, 피터 틸과 같은 미래의 테크 거물들의 관심을 끌었다.

코디네이터는 나름의 비판에 직면했다. 일각에선 코디네이터가 관료제 조직에서 창의성을 억압하는 위계적 통제를 강화한다고 비난했다. 코디네이터도 결국 퍼셉트론처럼 기업과 정부 관청 내의 이른바 '효율성 로비1'의 의제를 수행했다는 것이다. 그것은 의사소통을 능률화하는 데 도움을 주었지만 종종 경영진의 목표에 부합하는 방식으로, 권력을 분산시키기보다는 통합했다. 이것이 필연적인 것은 아니었다. 의사소통의 모호성이 일상적인 사회운동에서도 이 소프트웨어를 사용하는 것을 쉽게 상상할 수 있었다. (아마도 월스트리트 점령 운동Occupy Wall Street나 사파티스타Zapatista 같은 분산형 운동보다는 시민권 운동과 같이 중앙집중화된 구조와 명확한 목표를 가진 운동에서 더 잘 작동했을 것이다.)

더 깊은 문제는 위노그라드와 플로레스가 촉진하려 했던 사회적 협응이라는 개념 자체에 있었다. 그들이 AI 세계로부터 거리를 두었음에도 불구하고, 그들의 접근방식은 여전히 목적론적 사고방식에 갇혀 있었다. 여전히 문제를 해결하고 정의된 목표에 도달하는 게 관건이었다. 이러한 프레임워크는 그들이 벗어나기를 희망했던 AI의 도구적 이성으로부터 완전히 탈피하지 못한 것이었다.

하지만 위노그라드는 AI 커뮤니티의 대부분보다 훨씬 더 자기성찰적이었다. 1987년의 한 강연에서 그는 기호적 AI—당시에는 의사와 변호사 같은 전문가의 판단을 복제하려 했던 규칙 기반 프로그램이 지배적이었다—와 베버식 관료제 사이의 놀라운 유사점을 관찰했다. "인공지능 기술이 정신에 미치는 영향은 관료제가 인간의 사회적 상호작용에 미치는 영향과 같습니다." 그는 말했다. 인공지능과 관료제 모두 관료주의적 사고방식과는 정반대로 여겨지는 모호성, 감정, 맥락이 제거된 환경에서 번성한다.

위노그라드는 이러한 유사성을 만들어낸 역사적 힘을 더 살펴보지 않았다. 하지만 최근의 역사적 설명들은 AI 연구가 처음부터 이미 관료제 시스템을 연구하거나 최적화하고 있던 사람들을 끌어들였을 수 있다고 시사한다. 기술사학자 조니 펜Jonnie Penn이 지적하듯이 허버트 사이먼이 대표적인 예다. 1940년대에 "공공행정의 과학"을 구축하려 했던 그는 1950년대 중반이 되자 "지능의 과학"을 구축하는 핵심 인물이 되었다. 두 시도 모두 합리성의 한계를 인정했음에도 불구하고 궁극적으로는 동일한 가치를 찬양했다. 바로 목표 달성의 효율성이다. 간단히 말해 그들의 프로젝트는 도구적 이성의 이상을 완성하는 걸 목표로 했다.

기업에서 정부 자금 지원 기관과 군대에 이르기까지 '효율성 로비'의 관료제가 AI에 끌린 것도 놀라운 일이 아니다. 종종 AI의 시발점으로 여겨지는 1956년 다트머스 워크숍 이전에도 이러한 기관들은 이미 비슷한 목표들을 추구하고 있었는데, 이는 특히 냉전 때문이었다. 냉전 시대의 지정학적 긴장은 기술, 감시, 방위 분야의 빠른 발전을 요구했다. 방대한 양의 정보를 처리하고, 의사결정을 향상시키며, 소련에 대한 경쟁력을 유지할 수 있는 도구를 개발하도록 기관들을 압박했다. 학계의 AI 연구 추진은 이미 이러한 기관들을 움직이고 있던 자동화 의제에 완벽하게 부합했다. 규칙 준수 강화, 생산 효율화, 정보와 전투 데이터 처리. 의사결정의 기계화와 효율성 극대화는 오랫동안 그들의 핵심 목표였다.

여기서 우리는 한 발 물러서서 냉전 시대의 제도적 압박이 없었다면 어떠했을지 물어봐야 한다. 왜 컴퓨팅의 세계사적 약속이 관료제적 합리성을 복제하는 데 국한되어야 하는가? 왜 이러한 기관들에 속하지 않은 사람들도 유망한 신기술—디지털 컴퓨터—이 인간의 삶에서 할 수 있는 역할에 대한 그토록 편협한 시각을 받아들여야 하는가? 이게 정말로 이 신기술이 제공할 수 있는 것의 최대인가? 과학은 컴퓨터가 어떻게 시민, 시민사회, 그리고 광의의 공공영역에 봉사할 수 있는지를 탐구하는 방향으로 나아갔어야 하지 않을까? 단순히 과정을 자동화하는 것이 아니라, 가능성을 시뮬레이션하고, 대안적 미래를 모델링함으로써 말이다. 이렇게 더 넓은 이해관계를 위해 목소리를 내는 사람은 과연 있었나?

과학에 대한 민주적 감독이 어느 정도 있는 사회라면 이러한 질문들이 진지한 탐구와 연구를 촉발할 수도 있었을 것이다. 하지만 1950년대 중반의 미국은 그렇지 않았다. '인공지능'이라는 용어를 만든 인물이자 다트머스 워크숍과 가장 관련이 깊었던 존 매카시(컴퓨터 과학자로 튜링상을 수상한 그는 당시 다트머스대학 교수였다)는 그의 맹방들과 자기 자신이 적절하다고 생각하는 대로 이 분야를 정의했다. 그들은 IBM과 같은 대기업 거인들과 동맹을 맺고 국방 예산을 확보했으며, 더 넓은 과학 커뮤니티를 완전히 우회했다. 후에 매카시는 이러한 비민주적 시작을 공개적으로 찬양하며 다음과 같이 말했다.

"만약 우리가 자문위원회의 일반적인 물리학자, 수학자, 생물학자, 심리학자, 또는 전기공학자들을 설득하여 상당한 국립과학재단(NSF) 자금을 AI 연구에 할당하도록 해야 했다면 AI는 미국에서 훨씬 더 천천히 발전했을 것입니다. (...) AI는... 국방고등연구계획국(DARPA)가 국방부 관련 문제와 관련이 있다고 여긴 컴퓨터 과학 분야 중 하나였습니다. 주류 과학계의 자문은 최소한만 받았습니다."

AI 연구자들은 과거를 돌이킬 때 다른 분야에서 AI에 대한 이해가 부족한 데 대해 곧잘 화를 내곤 한다. 그러나 초기 연구자들에게도 그들만의 맹점이 있었다. 지루함과 같은 주제를 개념화하지 못한 것은 단순한 실수가 아니었다. 그것은 비목적론적 형태의 지능—문제 해결이나 목표 달성에 초점을 맞추지 않는—을 다루는 데 있어서의 근본적인 실패를 반영한다. 모든 지능을 문제 해결과 목표 달성의 문제들로 환원함으로써 그들은 대안적 경로들을 간과했다. 컴퓨터 기술이 어떻게 다른 형태의 지능을 증폭하고, 증강하며, 변형시킬 수 있는지, 또는 기술 자체가 이들을 수용하고 육성하기 위해 어떻게 진화해야 하는지를 탐구하는 경로들을 무시한 것이다.

공평하게 말하자면 그들이 이러한 질문들을 하지 않은 것은 놀랍지 않다. 효율성 로비는 자신들이 원하는 것을 정확히 알고 있었다. 능률화된 운영, 증가된 생산성, 그리고 더 강화된 위계적 통제. 새롭게 등장한 AI 패러다임은 이 모든 것과 그 이상을 약속했다. 한편 대안을 옹호하는 시민이나 사회운동—'인간성 로비Humanity Lobby'라 하자—의 조직적 반발은 없었다. 만약 그런 게 있었다면 그 대안은 어떤 모습이었을까?

1953년 '콜로라도 쿼털리'는 발명가이자 라디오 기술자였고 소설가로도 이름을 날린 한스 오토 스톰Hans Otto Storm의 에세이를 사후 발행했다. 그는 진주만 공격 후 불과 나흘 만에 샌프란시스코에서 미군을 위한 무선 송신기를 설치하던 중 감전사하는 비극적인 죽음을 맞이했다. 그의 주목할 만한 문학 경력에도 불구하고, 처음에는 출판사들에게 퇴짜를 맞았던 이 짧은 에세이가 그의 유산을 살아있게 했다.

스톰은 과격한 이단적 경제학자 소스타인 베블런의 제자이자 친구였다. 베블런은 '제작본능workmanship'을 자본주의적 과잉에 대한 엔지니어의 해독제로 찬양한 것으로 널리 알려져 있지만 그의 사고는 과학계를 만났을 때 매혹적이고 심지어 유희적인 전환을 보였다. 아마도 실용주의자들과의 연결에 영향을 받아, 베블런은 과학계에서 작동하는 다른 힘을 발견했다. 그가 "한가한 호기심"이라고 부른, 과학적 발견을 이끄는 일종의 목적 없는 목적이었다. 방향성 있는 사고와 방향성 없는 사고 사이의 이러한 긴장은 스톰 자신의 이론적 혁신에 결정적이 되었다.

스톰은 그가 '장인정신craftsmanship'이라고 부른 것의 두 가지 방식 사이에 비슷한 중요한 구분을 만든다. 둘 중 더 친숙한 것은 베블런의 기술자의 사고방식에 뿌리를 둔 "설계"다. 특정한 목표—예를 들어, 건물을 짓는 것—로 시작하여 그 목적을 달성하기 위한 최선의 재료를 선택하는 방식으로 진행된다. 본질적으로, 이는 단순한 도구적 이성이다. (스톰은 베버의 모든 저작에 상당히 익숙했고 이에 대해 논평했다.)

'장인정신'의 두 번째 방식은 무엇인가? 스톰은 이 대안에 '에올리시즘eolithism'이란 이상한 이름을 붙였다. 이를 설명하기 위해 그는 우리에게 석기 시대의 '에올리스'(원석기), 즉 "인간이 주워서 사용했고 심지어 사용을 위해 약간 가공된" 돌들을 상상해보라고 한다. 현대 고고학자들은 에올리스가 이러한 종류의 인간 개입의 결과라는 것에 의문을 제기한다. 풍화나 무작위적 파손과 같은 자연적 과정의 결과일 가능성이 높다는 것이다. 하지만 이 사실이 스톰이 이 돌을 가지고 보여주는 사상이 가진 힘을 약화시키지는 않는다.

그의 표현을 빌자면 핵심은, "돌들이 이미 목적에 맞게 어느 정도 잘 적응된 형태로, 그리고 더 중요하게는, 그 목적을 강하게 시사하는 형태로 주워졌다는 것이다. 우리는 (고대인이) 배부르고 만족한 상태로 아무런 생각 없이 돌밭을 거닐다가—이것들이 바로 이 기술에 유리한 조건들이니까—우연히 그의 눈에 창끝에 적합할 수 있는 돌이 들어왔을 때를 상상해볼 수 있다. 바로 그 순간 '창'이라는 프로젝트가 시작된다. 돌을 주워든다. 현대적 용어를 사용하자면 창이 제조 중에 있다. (...) 그리고 만약 (...) 창끝이 약간의 가공 과정에서 완전히 잘못된 방향으로 갈 경우, 자연스레 다른 용도로 전환될 수 있는 빠른 가능성이 항상 남는다."

도구적 이성의 설계 방식과의 대비는 더할 나위 없이 뚜렷하다. 에올리시즘은 해결할 미리 정의된 문제도, 추구할 고정된 목표도 상정하지 않는다. 스톰의 석기시대 산책자flâneur는 '죄수의 딜레마' 같은 냉전 시대의 사고실험에서 보이는 종류의 합리성과 극명한 대조를 이룬다. 또한 그렇기 때문에 오히려 더 낫다. 미리 정해진 목표가 없다는 점은 산책자가 세상을 더 풍부하게 볼 수 있는 능력을 넓혀주는데 이는 잠재적 목적의 다양성이 그것들을 달성하기 위한 수단으로 간주될 수 있는 것을 확장시키기 때문이다.

이것이 베블런의 '한가한 호기심'이 실제로 작동하는 모습이다. 한가한 호기심에서 분리되면 설계 원칙들은 근본적으로 제한적이 된다. 그것들이 고정되어야 하고 미리 정해진 목표들을 요구하고 방법과 재료 모두에서 다양성을 제거해야 하며, 재료의 본질적 가치를 그저 미리 정해진 목적들을 수행하는 것으로 환원시키기 때문이다. 스톰은 대량 생산의 획일적인 방법을 사용하여 대규모로 문제를 해결하기 위해 설계를 적용하려는 노력들이 사람들로 하여금 에올리시즘만이 제공할 수 있는 토착적이고 이질적인 해결책을 갈망하게 만든다고 주장한다. 에올리시즘의 정신은 현대까지 이어지며, 예상치 못한 인물들 속에서 구현된다. 스톰은 고물상을 가장 전형적인 에올리시즘적 캐릭터로 지목한다.

스톰을 "브리콜라주"라는 개념을 제시한 클로드 레비스트로스나 아이들과 그들의 장난감을 관찰한 장 피아제처럼 비슷한 지적 영역을 탐구한 다른 사상가들과 구분 짓는 것은, 에올리시즘적 사고방식을 고대의 것이나 단순히 원시 사회나 유아기의 한 단계로 취급하기를 거부한다는 점이다. 경직된 것보다 이질적인 것에 대한 이러한 갈망은 사람이나 사회가 발전하면서 극복하게 되는 것이 아니다. 오히려 그것은 현대에도 지속되는 인간 경험의 근본적인 부분이다. 사실 이러한 추구는 일각에서 포스트모더니티와 연관 짓는 바로 그 정신—유희적이고, 독특하며, 토착적이고, 경직된 계획과 획일적인 해결책을 넘어서는—을 불어넣을 수도 있다.

그렇다고 해서 에올리시즘적 경향이 스톰의 시대에 위협받지 않았다는 것은 아니다. 특히 효율성 로비가 선호하는 필요들을 고려하면 더욱 그렇다. 실제로 스톰은 전문교육의 대부분이 본질적으로 반에올리시즘적 편향을 가지고 있다고 주장하며 "훌륭하고 미성숙한 에올리시즘적 장인들"이 "공학을 공부하라는 권유를 받았지만 나중에서야 그들을 매료시켰던 독창성과 섬세한 검약 정신을 버려야 한다는 사실을 발견하게 된다"고 한탄했다. 하지만 과학과 공학에서도 효과적인 학습—특히 초기 단계에서—은 설계 방식의 알고리즘적 경직성을 피함으로써 성공한다. 효과적인 학습은 교육 철학자이자 한때 사이먼의 협력자였던 데이비드 호킨스가 "이것저것 해보기"라고 부른 것으로 시작되는 경우가 많다. (스톰의 친구이자 로버트 오펜하이머의 전 조수였던—그들 모두 1930년대 후반 캘리포니아의 같은 좌파 서클에서 활동했다—호킨스는 스톰의 에세이가 사후에 출간될 수 있도록 했고 과학기술자들을 비롯한 대중들에게 스톰의 사상을 전파하는 데 많은 노력을 기울였다.)

스톰은 철학자가 아니었고 그의 짧은 에세이에는 인용이 없지만 그의 관점은 실용주의 철학의 핵심 테마를 떠올리게 한다. 우리가 정말로 수단과 목적을 별개의 범주로 이야기할 수 있을까? 우리가 수단과 맺는 관계가 우리가 달성하고자 하는 바로 그 목적을 수정하도록 만드는 경우가 적지 않은데 말이다. 스톰의 용어로 말하자면, 목적을 가진 행동 자체가 일련의 에올리시즘적 충동의 결과로 나타날 수 있다.

이 모든 것이 AI에 대한 유토피아적 비전과 무슨 관련이 있는가? 만약 우리가 지능을 순전히 문제 해결과 목표 달성으로 정의한다면 아마 별로 관련이 없을 것이다. 스톰의 선사시대 목가에는 해야 할 심부름도, 이루어야 할 위대한 프로젝트도 없다. 우리가 아는 한, 그의 석기시대 방랑자는 깊은 지루함을 경험하고 있을지도 모른다. 스톰이 추측하듯 "가급적 아무 생각도 하지 않은 채."

하지만 산책자가 갑자기 에올리스를 발견하는 순간—그것의 용도를 구상하든 단순히 아름답다고 느끼든—을 우리가 지능에 대해 생각하는 방식과 무관하다고 무시할 수 있을까? 만약 그렇다면 우리가 오랫동안 인간 이성의 특징으로 여겨온 활동들—상상력, 호기심, 독창성을 어떻게 이해해야 할까? 효율성 로비는 이에 대해 관심이 별로 없을 수 있다. 하지만 교육, 예술, 또는 대안적 미래를 탐구하고 토론할 수 있는 건강한 민주적 문화에 관심을 가진 이들도 이를 무시해야 할까?

언뜻 보기에 스톰의 방랑자가 하는 행위는 유희적인 재분류recategoriztion—돌을 자연물의 영역에서 도구의 영역으로 옮기는 것—에 불과한 듯 보일 수 있다. 하지만 이 과정은 기계적이지 않으며 지능의 결여와도 거리가 멀다. 어떤 것이 유용한 도구인지 아니면 유희적인 인공물인지는 종종 보는 이의 시선에 달려있다. 마르셀 뒤샹(소변기를 예술 작품으로 선언한 것으로 유명한)이나 브라이언 이노(뒤샹의 그 작품에 소변을 봄으로써 그것을 단순한 갤러리 전시품이 아닌 전복적 인공물로서의 지위를 되찾으려 한 것으로 유명한)에게 물어보라.

스톰은 에올리시즘의 주요 예시로 아이들의 놀이를 지목한다. 그는 또한 모든 사회적 상황, 행위자, 제도적 환경이 똑같이 에올리시즘에 우호적이진 않다는 점을 분명히 한다. 우리 중 일부는 학교에서 이러한 사고방식을 교육받지 못했을 수 있다. 어떤 이들은 용도 변경이 불가능한 고도로 정교하고 고정된 기술적 물체들에 둘러싸여 있을 수 있다. 하지만 스톰의 목록이 에올리시즘에 영향을 미치는 요인의 전부는 아니다. 산책자의 기술, 호기심, 교육부터 개인의 행동을 지도하는 규칙과 규범의 경직성, 그리고 에올리시즘적 물체들이 잠재적 용도를 "제안"하고 "수용"하는 능력에 이르기까지 많은 다른 요인들이 작용한다.

이로써 우리는 도구적 이성을 훨씬 넘어서는 인간 지능의 관념에 도달했다. 우리는 이를 대조적으로 생태적 이성이라고 부를 수 있다. 불확정성과 우리 자신과 환경 사이의 상호작용적 관계를 모두 강조하는 지능에 대한 관점이다. 우리의 삶의 프로젝트들은 독특하며 이러한 개별적 프로젝트들을 통해 '에올리스'의 다양한 잠재적 용도가 우리 각자에게 나타난다.

그 의미상 거의 맥락이 없고 형식화하기 쉬운 도구적 이성과 달리, 생태적 이성은 뉘앙스와 차이에서 번성하며 따라서 자동화에 저항한다. 생태적 이성이 생겨나는 의미의 우주는 끊임없이 변화하기 때문에 그 전체를 형식화하기란 불가능하다. 이는 실현 가능성의 문제가 아니라 논리적 일관성의 문제다. 기계에게 이러한 형태의 지능을 행사하라고 요구하는 것은 마치 로르샤흐 테스트2를 받으라고 하는 것과 같다. 기계가 로르샤흐 테스트에 대한 응답을 생성할 수는 있을 것이다. 특히 방대한 양의 인간의 응답 데이터로 훈련을 받았다면 그럴싸한 답을 내놓을 수 있겠지만 그런 답변은 아주 간단한 이유 때문에 공허하게 들릴 수 밖에 없다. 기계는 로르샤흐 이미지를 해석하는 과정을 의미 있게 만들 수 있는 방식으로 사회화되지 않았기 때문이다.

하지만 형식화가 불가능하다고 해서 생태적 이성이 다른 방식으로 기술화technologize될 수 없다는 건 아니다. 아마도 적절한 질문은 40년 전 위노그라드가 제기한 것과 비슷할 것이다. AI 도구가 생태적 이성을 구현할 수 있는지 묻는 대신, 인간이 생태적 이성을 실행하는 것을 AI 도구가 향상시킬 수 있는지를 물어야 한다.

이렇게 질문을 구성하면 조심스러운 낙관론의 근거가 나온다. 적어도 1980년대 위노그라드의 비판 이후 AI가 급진적으로 진화했기 때문에 그러하다. 오늘날의 AI는 더 이질적이고 목적에서 자유로운open-ended 사용을 허용한다. 현대 AI의 일반성과 내재적 목적의 부재는 실험을 용이하게 한다. 초기의 AI 시스템들의 기본 응답은 딱딱한 "컴퓨터가 거부한다"는 식이었을 수 있지만 현대의 AI는 환각을 통해 답을 찾아간다. 이러한 변화는 그것의 기저 방법론에서 비롯된다. 위노그라드가 베버식 관료제라고 비판했던 규칙 기반 전문가 시스템과 달리, 오늘날의 거대언어모델(LLM)들은 데이터와 통계에 의해 구동된다. 아직도 일부 규칙들이 현대 AI의 근간을 이루고 있긴 하지만 AI의 출력물output은 고정된 프로토콜이 아닌 변화하는 데이터에 의해 도출된다.

게다가 이러한 모델들은 관료제의 경직성보다는 시장의 유연성을 더 닮았다. 시장 참여자들이 과거 트렌드에 의존해 빠르게 변하는 맥락을 잘못 판단할 수 있는 것처럼, 거대언어모델들은 통계적 패턴을 기반으로 출력물을 생성한다. 때때로 환각을 일으키고 맥락을 잘못 이해할 위험을 감수한다. 프리드리히 하이에크는 심리학도 다뤘는데 그의 심리학 연구는 초기 신경망 연구에 영향을 미쳤다. 하이에크가 뇌와 시장이 작동하는 방식에서 등가성을 본 것은 우연이 아니다. (퍼셉트론의 창시자인 프랭크 로젠블랫은 하이에크를 긍정적으로 인용한다.)

언어 앱을 제작을 목표로 했던 나의 작은 프로젝트에서, 나는 마치 근심 없는 스톰식 산책자처럼 시작했다. 특정한 문제를 해결하는 것에 신경 쓰지 않았다. 나는 언어를 배우는 데 쓴 시간을 세거나 가장 효율적인 전략을 찾으려 하지 않았다. 그 대신 세 가지 AI 기반 서비스 중 하나를 사용하면서—스톰의 돌을 우연히 발견한 것과 같은—나는 이 도구를 다른 두 개와 연결할 수 있을지 궁금하게 만드는 기능을 발견했다. 나처럼 코딩을 모르는 사람이 이러한 서비스들을 얼마나 쉽게 결합할 수 있을지에 대한 나의 직감이 맞았을까? 나는 궁금해할 필요가 없었다. 챗GPT를 통해 즉시 시험해볼 수 있었다. 이런 의미에서 챗GPT는 에올리스 그 자체는 아니다. 너무 무정형하고, 형태가 없으며, 너무 일반적이니까. 하지만 챗GPT는 에올리시즘적 산책자가 자신의 발견물을 가지고 가서 그것이 실제로 무엇에 좋은지 알아보는 실험적 작업장과 더 비슷하게 기능한다. 다시 말해 그것은 우리가 발견한 돌이 창끝으로, 장난감으로, 또는 예술 작품으로 더 적합한지 시험해볼 수 있게 해준다.

간단히 말하자면 여기에 에올리시즘의 요소들이 있긴 하지만 이것이 우리가 희망할 수 있는 최선과는 거리가 멀다고 생각한다. 우선, 내가 사용한 세 가지 서비스 모두 구독료나 사용료가 있다. 텍스트를 오디오로 변환하는 서비스는 한 달에 99달러(14만원)라는 거액을 청구한다. 벤처캐피탈로부터 많은 투자를 받은 이런 서비스들이 청구하는 요금만으로는 전력을 많이 소비하는 생성AI를 운영하는 데 드는 에너지 비용조차 감당하지 못할 수 있다. 이는 마치 누군가가 원래의 에올리스가 발견된 돌밭을 사유화하고, 새로운 소유자들이 높은 입장료를 부과하는 것과 같다. 생태적 지능을 극대화하는 방법은 아닌 것이다.

현대 AI 서비스의 전반적인 셋팅에는 지나치게 개인주의적인 면이 있다. 스톰의 비사회적인 선사시대 예시가 비껴가는 문제다. 물론 나는 민간 서비스들을 혼합하여 개인화된 언어 학습 앱을 만들 수 있고, 그 결과물이 매우 효과적일 수도 있다. 하지만 이런 모델이 확장 가능한가? 사회적으로 바람직한가? 기차로도 충분한 상황에서 내가 자동차를 운전하는 것과 같은 상황은 아닌가? 예를 들어, 약간의 효율성과 개인화를 포기하고 내 앱에서 이미 생성한 문장이나 단편적인 이야기들의 일부를 재사용해서 각각의 사용자를 위해 이러한 서비스를 처음부터 다시 실행하는 데 드는 에너지 비용을 줄일 수 있지 않을까?

이는 오늘날 생성AI의 핵심 문제로 우리를 인도한다. 오늘날의 AI는 단순히 시장의 운영 원리를 반영하는 것이 아니라 시장의 정신ethos을 구현한다. 놀랍지 않은 일이다. 사용자를 무엇보다도 소비자로 취급하는 테크 대기업들이 이런 서비스들을 지배하고 있기 때문이다. 오픈AI나 다른 AI 기업이 굳이 내가 그들의 서버에 더 적은 쿼리3를 보내거나 내 앱을 만들 때 다른 사람들이 이미 받은 응답을 재사용하도록 장려할 이유가 어딨겠는가? 사회적이거나 정치적 관점에서는 (생태적 차원에선 말할 것도 없이) 더 나을 수 있지만 그들의 사업 모델을 약화시킬 것이다. 대신 오픈AI의 API는 런던이 영국의 수도라거나 1킬로그램이 1000그램이라는 것을 알려주는 데에도 요금을 부과하고 무시할 수 없는 양의 탄소를 배출한다.

챗GPT와 같은 도구들이 생태적 이성에 기여하는 모든 방식에도 불구하고 오늘날의 AI 도구들은 더 깊은 수준에서 생태적 이성을 약화시킨다. 이는 주로 우리의 활동을 포스트모던 소비자들의 고립되고—아마도 소외된—정체성을 중심으로 구성함으로써 이루어진다. 우리가 오늘날의 AI 도구들을 문제 해결에 사용할 때, 우리는 스톰의 근심 없는 산책자처럼 모든 것에 열려있지 않다. 미리 정의된, 이윤지향적 틀 안에서 차익거래의 기회를 찾는 기업가에 더 가깝다. 이러한 조건에서도 에올리시즘적 브리콜라주가 일어날 수 있지만 전반적인 셋팅이 생태적 이성의 온전한 잠재력과 유희를 제약한다.

여기서도 챗GPT는 '코디네이터' 소프트웨어를 닮았다. 이는 마치 우리의 자본주의적 포스트모더니티가 여전히 그 이전의 복지-전쟁 모더니티를 닮은 것과 같다. 코디네이터가 조직인의 도구적 이성 실행을 강화했다면 챗GPT는 오늘날의 신자유주의적 주체—일부는 소비자이고 일부는 기업가인—가 생태적 이성을 잠시나마 엿보고 심지어 그것과 노닥거릴 수 있게 해준다. 표면적인 인간 자유의 증대는 더 깊은 부자유를 감춘다. 그 배후에는 여전히 통제권을 쥐고 있는 효율성 로비가 있다. 이것이 바로 이러한 강력한 기술들을 통한 우리의 해방이 그토록 불완전하게 느껴지는 이유다.

실리콘밸리는 계속 호언장담하겠지만 그들의 기술이 더 큰 문제들을 다룰 수 있는 능력을 갖추게 되더라도 이러한 불완전한 해방감은 사라지지 않을 것이다. 만약 딥러닝 시스템의 주요 매력이 상대적으로 단순한(저렴하거나 기후 친화적이지는 않더라도) 접근방식으로 매우 다양하고 복잡하며, 심지어 독특한 작업들을 수행할 수 있는 능력이라면, 우리는 이미 이러한 종류의 기술을 가지고 있음을 기억해야 한다. 바로 시장이다. 만약 쇼핑 목록을 셰익스피어식 소네트로 바꾸고 싶었다면 굳이 챗GPT가 등장하길 기다릴 필요가 없었다. 적절한 사람을 찾을 수 있고 그에게 적절한 가격을 지불할 의향이 있었다면 누군가가 그것을 해줬을 것이다.

신자유주의자들은 이를 일찍이 인식했다. 적어도 이론상으로는, 시장은 민주적 정치보다 훨씬 더 효율적이고 간소화된, 문제 해결을 위한 보편적 방법을 약속한다. 하지만 현실은 냉정하다. 실제 시장은 너무나 자주 흔들리며, 종종 문제를 해결하는 데 어려움을 겪고 때로는 상황을 훨씬 악화시킨다. 그들은 토착적 지혜나 공공의 감독에 기반한 비시장 시스템보다 성과가 떨어진다. 시장은 자연스럽거나 자발적인 현상과는 거리가 멀다. 시장을 효과적으로 기능하게 만들기 위해서는 엄청난 노력이 필요하다. 시장은 시민들이 보유한 암묵지와 형식지의 방대한 저장고를, 또는 적어도 기업가적 사고로 환원될 수 없는 종류의 지식을 쉽게 활용하지 못한다. 시장은 그것을 오직, 뭐랄까, 존재의 광대한 영역을 식민화함으로써만 동원할 수 있다. (관료제는 또한 신자유주의가 오기 훨씬 전부터 비슷한 한계에 직면했다. 비록 시민 참여에 대한 그들의 무시는 다른 동기에서 비롯되었지만.)

이러한 한계들은 잘 알려져 있으며, 이것이 바로 필수 서비스의 상품화에 대한 지속적인 저항과 공공재의 사유화를 되돌리려는 압박이 증가하는 이유다. 생성AI의 상업적 성장통이 2년째에 접어들면서, AI에서도 비슷한 깨달음의 순간이 다가오고 있다. AI가 전반적으로 기업의 통제 하에 남아있는 한, 큰 사회적 문제들을 해결하는 데 AI에 의존하는 것은 시장을 신뢰하는 것과 다름없을 것이다.

대안은 무엇인가? 도구적 이성으로부터 벗어나는 의미 있는 진전을 이루려면 효율성 로비와의 관계를 단절하는 의제가 필요하다. 이러한 단절은 일상적, 공동체적, 또는 심지어 도시적 존재를 훨씬 넘어서는 수준에서 일어나야 하며, 국가적이고 아마도 지역적인 초점의 전환을 필요로 한다. 이런 일은 미국에서—연방 예술 프로젝트Federal Art Project를 통한 예술가 지원과 같은 뉴딜의 특정 요소들을 제외하면—한 번도 이루어진 적이 없지만 다른 나라의 역사는 그런 일이 어떻게 일어날 수 있는지에 대한 몇 가지 단서를 제공한다.

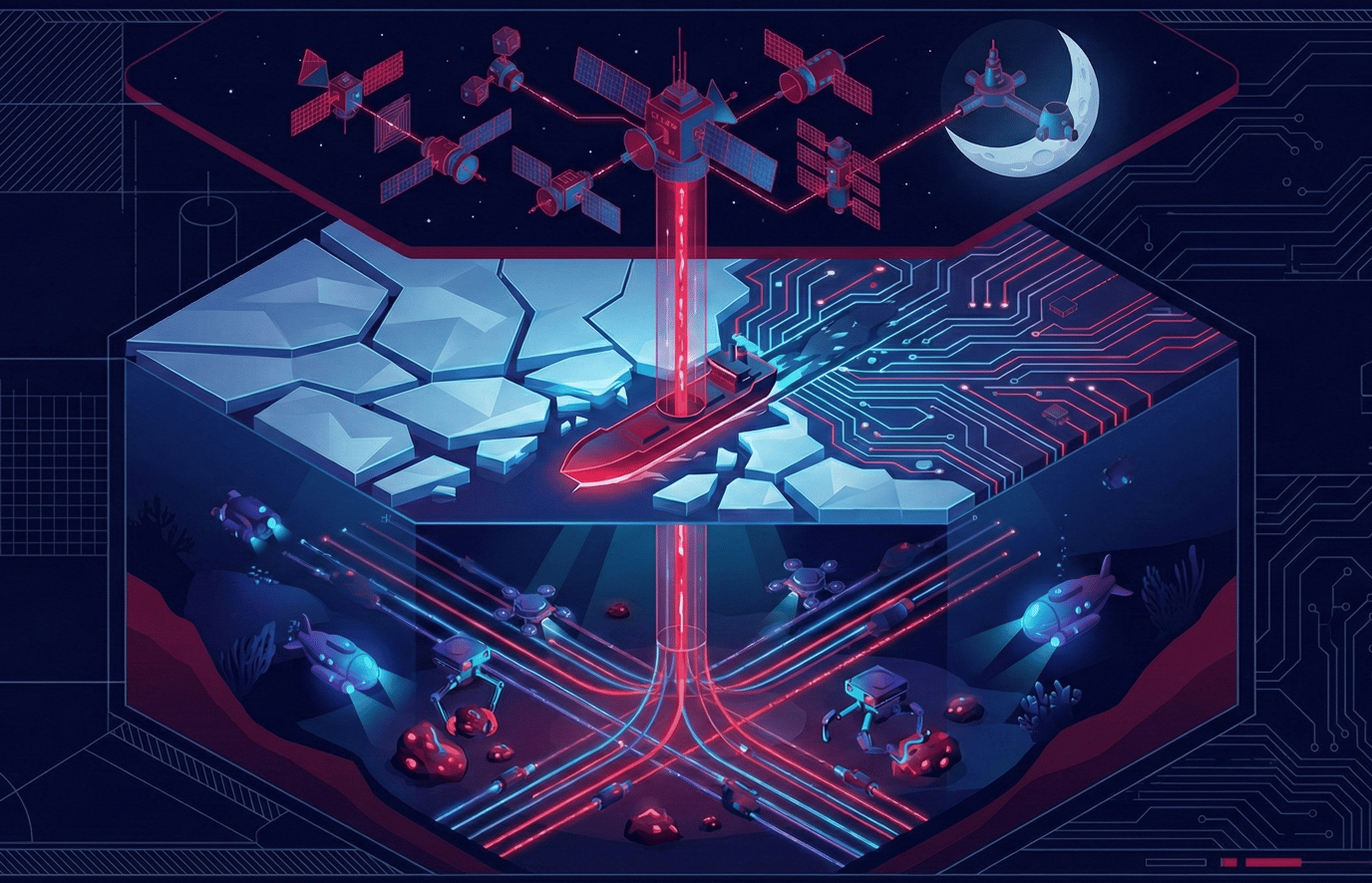

1970년대 초, 살바도르 아옌데의 칠레는 노동자들을 주요 산업의 소유자일 뿐만 아니라 관리자로 만듦으로써 그들에게 권한을 부여하고자 했다. 결국 쿠데타로 이어진 매우 불안정한 정치적 환경에서 아옌데 정부는 이러한 전환을 촉진하기 위해 부족한 정보기술을 활용하고자 했다. 프로젝트 사이버신Project Cybersyn으로 알려진 이 시스템은 도구적이고 기술적인 이성을 증진시키기 위한 것이었으며 일상적인 행정 업무의 수행을 국가적, 산업적, 전사적 대안들에 대한 심의와 결합하고자 했다. 이제 관리직을 맡게 된 노동자들은 유명한 '운영실Operations Room'에서 시각화 및 통계 도구들을 사용하여 정보에 기반한 결정을 내리게 될 것이었다. 이 프로젝트를 의뢰한 사람은 다름 아닌 아옌데 행정부의 장관이자 훗날 위노그라드와 협력하게 되는 페르난도 플로레스였다.

같은 시기에 일군의 아르헨티나 과학자들이 잠재적인 국가적—그리고 세계적—대안들에 대한 논의를 촉발하기 위해 컴퓨터를 사용하려는 독자적인 노력을 시작했다. 이러한 계획들 중 가장 돋보이는 것은 바릴로체 재단Bariloche Foundation에서 나온 것이었는데 이는 1972년의 '성장의 한계The Limits to Growth'와 같은 보고서들에서 발견되는 많은 지정학적 가정들—특히 저개발된 글로벌 사우스가 과잉 개발된 글로벌 노스를 "구하기" 위해 희생을 해야 한다는 관념—에 이의를 제기했다.

이러한 지적 환경에서 또 다른 중요한 인물은 "규범적 계획normative planning"을 옹호한 재능 있는 과학자 출신 활동가 오스카 바르사프스키Oscar Varsavsky였다. 컴퓨터를 사용하여 단일하고 미리 정해진 경제적, 정치적 진보의 궤적을 예측하려 했던 현대화 이론의 지지자들과 달리, 바르사프스키와 그의 동료들은 기술을 다양한 사회적 궤적을 지도화하는 수단—그들이 "수치적 실험"이라고 부른 방법을 통해—으로 보고 사회경제적 발전의 대안적 스타일들을 도표로 만들고자 했다. 바르사프스키는 그 중에서 "히피", "권위주의", "기업 중심", "창의", "인간 중심"을 포함하는 스펙트럼을 식별했는데, 후자의 두 가지가 그가 선호하는 모델이었다.

따라서 컴퓨터 기술은 시민들이 각 경로와 관련된 가능성, 결과, 비용을 탐구할 수 있게 하여, 그들의 가치관과 이용 가능한 자원 모두와 부합하는 옵션을 고를 수 있게 할 것이었다. 이러한 의미에서 정보기술은 우리의 에올리시즘적 산책자의 작업장을 닮았다. 단순한 관리나 효율성 추구가 아닌, 상상, 시뮬레이션, 실험을 위한 공간인 것이다.

현대의 예산 참여 실험에서 통계 소프트웨어의 사용—비록 대부분이 여전히 국가적 수준이 아닌 지역적 수준에 한정되어 있지만—은 그런 공약을 반영한다. 통계적 도구를 사용하여 다양한 지출 옵션의 결과를 조명하고 시민들이 그들이 선호하는 것을 택할 수 있게 만드는 게 목표다. 두 경우 모두, 이 과정은 문제 해결만큼이나 파울로 프레이리Paulo Freire가 말한 "문제 제기"—공공의 검토와 심의에 노출시킴으로써 문제에 대한 경쟁적 정의들이 드러나게 하는 것—의 개선에 관한 사안이다.

라틴아메리카의 사례들을 하나로 묶는 것은 생태적 이성의 증진이 글로벌노스에 의해 부과된—이데올로기적, 재정적, 군사적으로—효율성 의제로부터 그들의 국가적 프로젝트들을 분리하지 않고는 이루어질 수 없다는 생각을 이 라틴아메리카 국가들이 공유했다는 사실이다. 그들은 얼핏 비정치적으로 보이는 소위 "근대화(또는 현대화)"의 언어가 종종 효율성 로비 내 다양한 파벌들의 정치적 이해관계를 감추고 있음을 인식했다. 다시 말해, 그들의 접근방식은 먼저 문제를 정치적으로 제기하고 그 다음에서야 기술적으로 접근하는 것이었다.

생태적 이성으로 가는 길은 이러한 전환을 이루지 못한 실패들로 가득하다. 1960년대 후반, 한 기술 괴짜들의 그룹—이들 중 다수가 MIT와 연관돼 있었다—이 스톰의 에세이에 영감을 받아 민간 연구소 '환경생태연구소Environmental Ecology Lab'를 만들었다. 그들의 목표는 문제 해결이나 특정 목적에 의해 추동되지 않는 행동을 기술이 어떻게 가능하게 할 수 있는지를 탐구하는 것이었다. 하지만 히피, 반항아, 반전 활동가로서 그들은 효율성 로비와 협력하는 데 관심이 없었고, 정치적 대안을 향한 실질적인 단계를 밟는 데 실패했다.

환경생태연구소 설립자들과 연결되어 있던 한 젊은 건축학 교수인 니콜라스 네그로폰테Nicholas Negroponte는 그런 거부감을 갖고 있지 않았다. 그들의 아이디어에 깊은 영향을 받은 그는 MIT미디어랩MIT Media Lab을 설립했다. 미국 재계와 펜타곤으로부터 자금을 지원받았음에도 컴퓨터를 통한 유희성을 기념하는 공간이었다. 그의 1970년 저서 '건축 기계: 보다 인간적인 환경을 향해The Architecture Machine: Toward a More Human Environment'에서 네그로폰테는 스톰의 에세이를 인용하기도 했다. 하지만 시간이 지나면서 이러한 유희성의 정신은 보다 도구적인 것으로 변모했다. "상호작용성" 또는 "스마트함"으로 재포장된 유희성의 정신은 CES 행사에서 최신 기기들의 판매 포인트가 되었다. 스톰이 구상했던 종류의 장인정신과 창의성과는 거리가 멀어진 것이다.

비슷하게 1970년대 초부터 시모어 패퍼트Seymour Papert—네그로폰테의 MIT 동료이자 또 다른 AI의 선구자였다—는 효율성과 도구적 이성에 대한 집착이 컴퓨터 문화 전반에 해로운 것임을 인식했다. 더 나쁜 것은, 그것이 많은 젊은 학습자들을 소외시켜 바로 그 도구적 이성의 구현체인 컴퓨터를 두려워하게 만들었다는 것이다. 위노그라드의 논문 지도교수였던 패퍼트는 AI를 완전히 포기하지는 않았지만 점점 더 교육에 초점을 맞추며 에올리시즘적 접근을 옹호했다. (피아제와 함께 일했던 그는 스톰의 에세이를 출간했던 교육 철학자 데이비드 호킨스의 작업에 대해서도 알고 있었다.) 하지만 두 연구소와 마찬가지로 패퍼트의 해결책들은 결국 기술적 해결책으로 기울어졌고 '한 아이당 한 대의 노트북'을 제공하자는 실패한 계획으로 귀결되었다. 정치성이 제거되면 에올리시즘이 솔루션주의4solutionism로 변질되기는 매우 쉽다.

라틴아메리카의 사례들은 글로벌 노스의 기술 발전에 대한 "대안이 없다"는 이데올로기가 거짓임을 보여준다. 1970년대 초 이 이데올로기는 현대화 이론에 근거했고 오늘날에는 신자유주의에 뿌리를 두고 있다. 하지만 결과는 동일하다. 이러한 기술들을 위한 대안적 제도적 터전을 상상하는 것이 금지된 것이다. 이러한 도구들을 시장 주도적 개발 모델로부터 분리하는 것이 가능할 뿐만 아니라 그것이 민주주의, 인류, 그리고 지구에 이롭다는 것을—실제 세계의 프로토타입과 제도적 개혁을 통해—입증하는 데는 엄청난 가치가 있다.

현실에서 이는 생성AI의 에올리시즘적 잠재력을 공공의, 연대에 기반한, 사회화된 인프라 대안들로 방향을 돌리는 것을 의미할 것이다. 내가 나의 자작 언어 앱을 자랑스러워하는 만큼, 같은 실험 정신으로 만들어진 비슷한 미완성 프로그램들이 수천 개 더 있으리란 걸 나는 안다. 테크 분야의 많은 이들이 개별 언어 학습자들의 문제 해결 능력을 쪼갬으로써 이익을 얻었다. 하지만 그렇다고 해서 우리가 그것들을 재조립하고 덜 개인주의적이고 더 집단적인 해결책을 추진할 수 없을 이유는 없다. 그리고 이는 다른 많은 영역에도 적용된다.

하지만 여기서 멈추는 것—LLM을 신자유주의에 덜 호의적이게 만드는 방법들을 열거하는 것—은 근시안적일 것이다. 이는 통계적 예측 도구들이 생태적 이성을 증진하는 유일한 방법이라는 잘못된 결론을 시사한다. 분명 오늘날의 지배적인 철학이 꿈꾸어 온 것보다 인간 지능을 육성하는 기술들이 훨씬 더 많이 있을 것이다. 우리는 생태적 이성을 완전한 연구 패러다임으로 전환해야 하며, 인간을 육신을 가진 온도조절기나 미사일 같은 존재로 보기를 멈추고 기술이 인간을 위해 무엇을 할 수 있는지 물어야 한다.

그렇게 하는 동안, 우리는 라틴아메리카에서 벌어졌던 실험들의 핵심 통찰을 잊어서는 안 된다. 기술의 해방적 잠재력은 오직 급진적인 정치 프로젝트를 통해서만 확보될 것이다. 급진적인 정치 프로젝트가 없으면 효율성 로비의 의제가 인류성 로비의 의제를 압도하지 않도록 보장하는 데 필요한 자원들을 모으기 어려울 것이다. 라틴아메리카 실험들의 비극적 실패는 이것이 쉬운 여정이 아닐 것임을 의미한다.

원래의 퍼즐—AI와 민주주의—에 관해서는 해결책이 명확하다. '민주적 AI'는 실제 민주주의와 함께 시민의 존엄성, 창의성, 그리고 지능에 대한 존중을 필요로 한다. 이는 단순히 오늘날의 AI 모델들을 더 투명하게 만들거나 비용을 낮추는 것에 관한 것이 아니다. 정책의 세부사항 조정이나 기술적 혁신으로 해결될 수도 없다. 진정한 도전은 생태적 이성에 근거한 올바른 세계관Weltanschauung—이 앱은 기적을 일으킨다!—을 육성하는 데 있다. 이러한 점에서 초기의 관료제이든 오늘날의 시장이든 지배적 질서를 위해 이데올로기적 간섭을 실행하는 AI의 능력이 가장 큰 위협을 제기한다.

의외로 생태적 이성의 작동을 설명하는 데 가장 근접했던 것은 미국의 실용주의자들이었다. 만약 초기 AI 커뮤니티가 존 듀이와 그의 '체화된 지능'에 대한 연구에 주의를 기울였다면 많은 잘못된 방향들을 피할 수 있었을 것이다. AI 비평가들이 하이데거 대신 듀이를 살펴보았다면 어떤 종류의 AI—그리고 AI 비평—을 가질 수 있었을지 궁금할 따름이다. 하지만 그 대안적 경로를 추구하기에는 아직 너무 늦지 않았을지도 모른다.

에브게니 모로조프는 기술과 정치를 연구한다. 저서로 'The Net Delusion'과 'To Save Everything, Click Here: The Folly of Technological Solutionism'이 있다. 최근작은 'A Sense of Rebellion'이란 팟캐스트다.

어제는 엔비디아, 오늘은 딥시크... AI에 대한 국내의 논의는 당장의 주목을 받는 토픽에만 함몰되는 경향이 있습니다. AI를 주도하고 싶다면 보다 본질적인 논의도 해야 하지 않을까요? AI의 새로운 돌파구는 오늘날의 대세인 거대언어모델(LLM)과는 다른 접근법—뉴로심볼릭 AI 같은—에 대한 기초과학 연구에서 나올지도 모릅니다. AI에 대한 기술사적, 철학적 고찰은 이런 점에서 실마리를 줄 수 있습니다.

에브게니 모로조프는 기술과 정치가 만나는 영역을 가장 성실하게 파고들면서 빅테크의 환상과 위험에 대해 오래 전부터 경고해 온 저자입니다. 모로조프가 2012년 뉴리퍼블릭에 기고한 스티브 잡스 비평은 그야말로 기술철학 에세이의 걸작이기도 하죠. 모로조프는 근래 들어 냉전 시대 라틴아메리카의 기술 활용 시도에 대해 많은 관심을 기울였는데(파이낸셜타임스 등에서 호평한 모로조프의 팟캐스트 '산티아고 보이즈'(2023)는 아래 본문에서도 거론되는 칠레 아옌데 정권의 프로젝트 사이버신 등을 다룹니다) 오직 자본의 '효율성'만 중시하는 (오늘날 지배적인 빅테크의) 기술이 아닌 '생태적' 기술 활용의 대안적 비전을 모색하는 시도였습니다.

모로조프의 AI 비평도 같은 문제의식에서 출발합니다. 원문이 7500단어가 넘는 장문이지만 읽고 나시면 AI 문제에 대해 완전히 새롭게 생각해 볼 수 있는 프레임을 얻을 수 있습니다. 미국의 문예·정치 저널 보스턴리뷰는 2024년 12월 '우리를 위한 AI AI We Deserve'란 제목의 포럼 시리즈에서 여기 소개하는 모로조프의 발제와 브라이언 이노, 오드리 탕 등의 저명 인사들의 코멘트를 실은 바 있는데 보스턴리뷰와의 라이센스 협약 하에 그 AI 포럼 시리즈를 전문으로 소개합니다. 다음주에는 브라이언 이노 등의 코멘트를 소개할 예정입니다. 이제는 AI 시대입니다.